從什麼時候開始,我們遇到問題,第一反應不再是詢問朋友,也不是上網慢慢找資料,而是直接「問AI」?

AI不僅是輔助工具,也漸漸主導我們的判斷。倘若這樣的依賴僅止於日常生活,或許無傷大雅。但當演算法開始介入社會治理、政策執行與資源分配,甚至司法判決時,問題就不再只是這項科技「好不好用」,而涉及到了人權、民主與法治等根本價值。

國立清華大學科技法律研究所所長林勤富,十分關注AI發展。他認為,一旦基於AI的決策開始動搖這些根本價值,法律就必須嘗試建立規範框架、平衡不同利益與期待,甚至在重要面向上劃出一條科技不可逾越的底線。

國立清華大學科技法律研究所所長林勤富

拍攝/翁佳如

技術沒有歧視,但結果可能很歧視

談到AI對社會的影響,我們首先聯想到可能是「隱私侵害」。但從法律與人權的角度來看,風險遠不只如此。

「其初衷未必帶有惡意,卻隨著資料越收越多,最終形成侵害。」林勤富指出,AI的運作依賴大量資料,是一種高度「渴求資料」(data‑thirsty)的技術。當大量零散的個人與公共資料被掌握並建模,演算法便能以過去為基礎來分類人事物、預測未來。正是在這個「分類」與「預測」的過程中,新的不平等悄然而生。

林勤富舉例:「近年有研究發現,搜尋引擎在投放工作廣告時,高薪或技術導向的職缺更常出現在男性使用者頁面上。女性即使具備相似條件,也較少看到這些機會。」

這並非系統設定刻意排除女性,而是演算法根據過往資料所建立的理解與預測邏輯,傾向將資源集中在被視為「有效受眾」的群體上。但如果歷史資料本就帶有性別偏差,例如男性長期在科技業或高薪職位中佔多數,此模式便會被演算法複製並放大執行,惡化社會中既有的不平等問題。

同樣的問題也出現在教育領域。林勤富提到,美國已有大學使用演算法挑選入學申請者。乍看之下,這麼做提高了不少效率,但倘若往年的錄取紀錄偏好富裕家庭的白人男性,訓練資料與演算法就可能延續過去的模式,進而排擠其他背景的申請者。這不僅剝奪了公平競爭的機會,更在無形中強化結構性歧視。

當網路搜尋引擎與推薦系統依賴帶有偏差的歷史資料來進行預測,便會產生不平等的結果。

圖片來源/Unsplash

AI治理,法律準備好了嗎?

如今,AI的資料來源與用途,早已超出傳統法律的設想與規範。面對AI浪潮,世界各國無不開始思考新的法律框架。

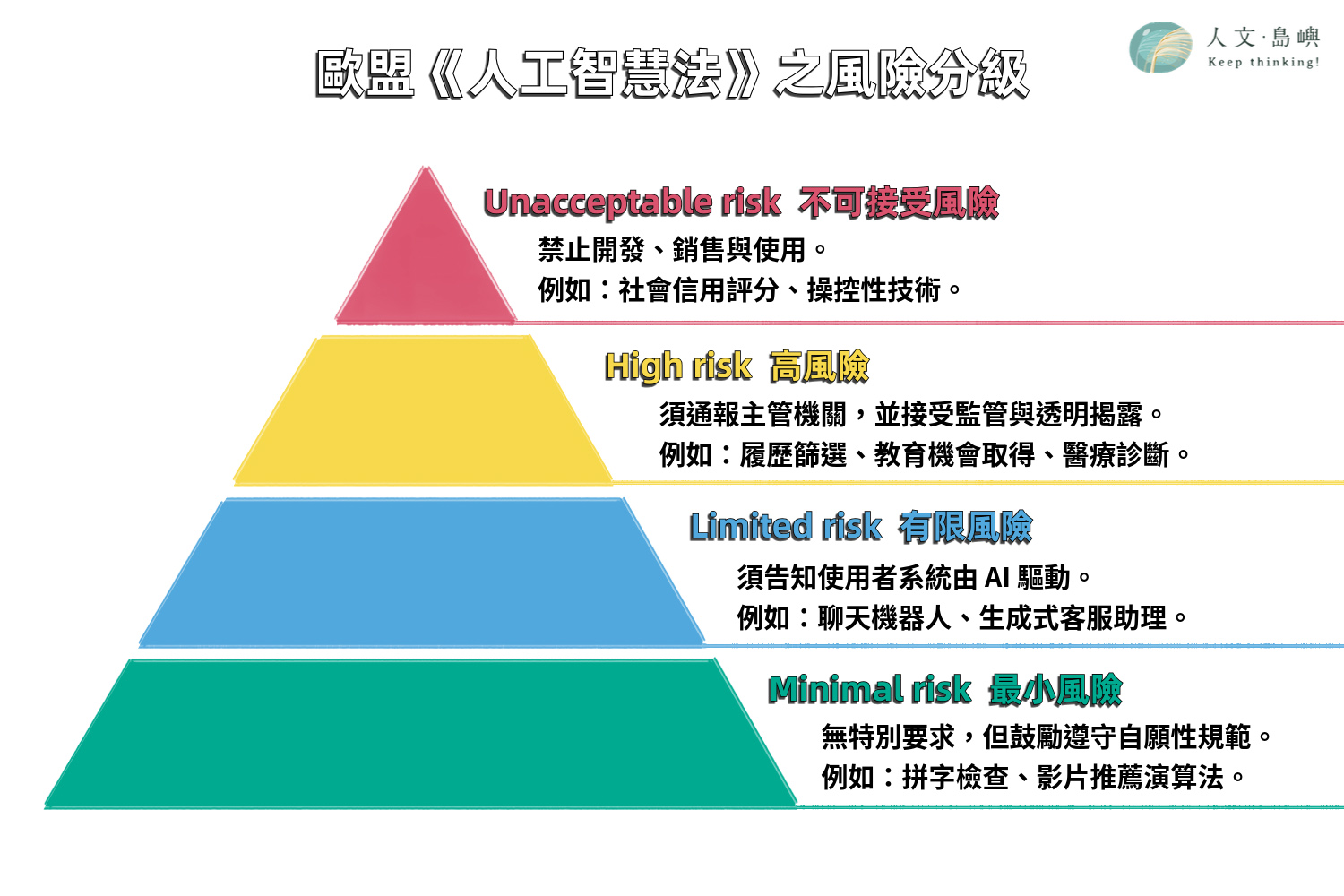

歐盟率先於2024年通過《人工智慧法》(AI Act),成為全球第一部針對AI監管的法規。該法案以人權保障為核心,尤其強調資料保護與決策過程的透明性與可責性。

林勤富解釋:「歐盟採取『風險分級』原則,將AI系統依照用途與社會影響程度,大略劃分為『禁止使用、高風險、有限風險與低風險』四個等級,並對開發者、部署者與使用者制定相應的規範。」

歐盟將 AI系統依風險等級進行分類監管,如被歸類為「高風險」的社會信用評分、教育與招聘篩選系統,必須受到嚴格監督。而涉及操控輿論或進行情緒辨識的技術,則被明文禁止。

圖片製作/馬藤萍

相較之下,美國尚未通過聯邦層級的AI綜合法規,近年提出的《演算法課責法案》(Algorithmic Accountability Act)等多項法案至今仍在審議中。林勤富觀察到,整體而言,歐盟的治理著重「人權保障」與「風險預防」,而美國傾向以產業與技術發展為優先。因此,歐盟採取了預防性管制,要求事前審查;美國的立法方向則傾向責任下放,由企業主動進行演算法影響評估、自主規制。

林勤富進一步指出:「另一個同樣積極投入AI發展的國家——中國,也展現出截然不同的思維與模式。儘管中國尚未建立一套完整的AI母法,但整體而言如同大型沙盒鼓勵破壞式創新,但在關鍵特定議題上亦有快速的嚴格監管。中國亦運用AI強化政府控制,其以『社會信用體系』為名的數位治理,實際上也是運用AI與大數據進行行為評分與社會監控。與西方國家相比,中國對AI的監管策略更側重於社會穩定與國家安全。」

全球共識,何其困難?

儘管越來越多國家開始重視AI治理,但現行的規範普遍聚焦在風險管理,對於技術背後更深層的倫理問題,卻仍難以給出明確答案。

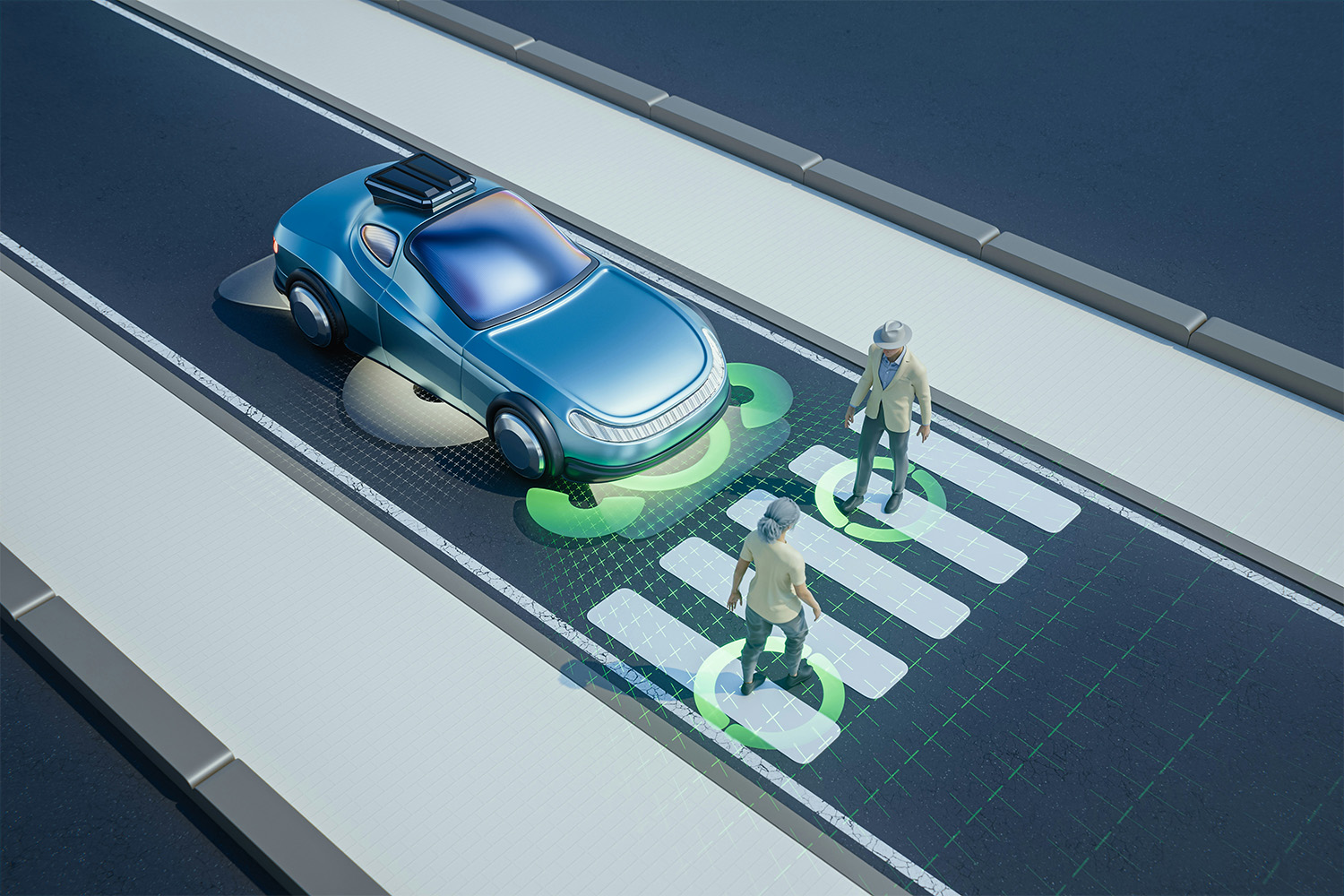

林勤富以經典的「電車難題」(Trolley Problem)為例說明。這個本是道德哲學的思想實驗,隨著近年「自動駕駛汽車系統」的發展,已從課堂上的假設情境,變成現實世界必須面對的法律問題。

「假如一輛自駕車遭遇不可避免的事故時,系統究竟是優先保護乘客,還是避免傷害路人?應優先保護孕婦,還是避免傷害長者?系統應重視交通規則之遵守,抑或是以減少整體傷亡為原則?」林勤富指出,不同於人類駕駛的瞬間反應不受倫理上的非難,這類「兩難抉擇」在未來已無法迴避,事實上早在演算法被寫入自動駕駛系統時,各種情境與對應決策就已被預設。

問題在於,演算法所仰賴的訓練資料往往反映了社會中既有的偏見與不平等。當面對倫理兩難,系統是否會依據年齡、性別或身體狀況等特徵進行選擇性保護,就成為一個難以迴避的倫理困境。

自駕車的選擇看似來自機器,實則來自人類。即使是AI,也是在執行我們尚未解決的道德兩難。

圖片來源/Unsplash

2017 年,德國發布全球第一份針對自駕車的《自動與聯網駕駛倫理準則》,明確主張:優先保護個體的生命權,禁止以生命數量進行權衡,或基於個人特徵(如年齡、性別、身體或精神狀況)等功利主義式的計算。

然而,看似普世的原則,卻不一定全球適用。林勤富提到,麻省理工學院媒體實驗室(MIT Media Lab)曾進行一項名為「Moral Machine」的大型全球實驗,收集了來自兩百多個國家、數千萬筆關於電車難題的選擇數據,並將研究結果發表在Nature期刊。

結果發現,不同文化背景的民眾,對於「該犧牲誰」的排序存在明顯不同:例如,東亞國家偏好集體主義、利他主義,傾向保護路人、守法者的生命;西方國家則強調個體的權利,乃至於有對體態健康者、女性的保護偏好。

「這種倫理差異,讓自駕車進入國際市場時面臨挑戰。」林勤富解釋,「自駕系統在進入某國市場時,必須符合當地的社會與法律框架。然而,自駕系統的核心演算法往往在特定制度與設計脈絡下開發,訓練過程充滿複雜性且不透明,導致決策邏輯難以說明,檢驗其是否符合銷售國的倫理準則也變得更加困難。」

林勤富提醒,從自駕車的案例可以看出,即使各國都積極推動AI的法制化,但面對跨文化的倫理衝突,單一規範也不易全面應對。

當 AI 被帶上法庭

儘管針對AI的治理架構仍未完善,但它其實早已進入法院,並對既有的制度正義形成挑戰。林勤富表示,美國司法系統使用多年的「COMPAS」(Correctional Offender Management Profiling for Alternative Sanctions),便透過演算法風險評估系統預測被告的再犯可能性,作為法官量刑的參考之一。

當司法引入AI,最大的風險不是法官被取代,而是人類可能會過度信任機器的建議。

圖片來源/Unsplash

但這樣的系統,真的公平嗎?林勤富分享了一起具代表性的案例:2013年,美國威斯康辛州男子Eric Loomis涉嫌飛車槍擊案。他否認開槍,但承認偷走涉案車輛,並選擇認罪協商。法院在量刑前要求提交一份「量刑前調查報告」,其中就包含COMPAS生成的再犯風險評估,結果他被標記為「最高度危險」。最終,他被判處六年有期徒刑及五年延長監管。

Loomis隨後提出救濟申請,要求重新量刑,理由是法院所參考風險評估報告違反了正當法律程序,因為他無從得知分數的計算如何而來。

「這是一種黑箱判斷,而所謂演算法黑箱更有不同類型的肇因、不同層次的挑戰。」林勤富指出,「在量刑過程中,司法的核心價值之一在於個別化裁量與正當程序。但像COMPAS這樣的工具,卻是根據統計模型與群體特徵進行預測,過程因營業秘密保護而不對外公開,導致被告無法挑戰或解釋結果是否合理。」

雖然威斯康辛州最高法院最終駁回Loomis的主張,認定COMPAS僅作為「參考」,並非唯一依據,且黑箱問題並不構成正當法律程序的違反。但林勤富提出反思:當一個人無法理解司法程序中影響其命運的關鍵依據,司法的公平性是否還能成立?法官面對一個被貼上「高風險」標籤的被告,是否仍能完全不受影響嗎?理解AI系統決策的邏輯、以及相關風險,是司法程序中運用的基本要求。

林勤富認為,若缺乏完善的透明與問責機制,AI就不應貿然應用於司法體系。但面對法律黑箱、技術黑箱等不同層次、不同類型的問題,在刑事、民事或其他程序中,應有不同的考量、規範與因應措施。尤其是在刑事審判中,這不僅影響法律的公正性,更直接攸關個人生命與自由。他提醒:「只要出現決策建議,人就容易被定錨,從而影響獨立判斷。」

拍攝/翁佳如

「AI可以輔助決策,但同時在必要場域也應具備透明性、可解釋性與問責性。」

林勤富坦言,AI治理並不容易——法律制度的演進,往往奮力緊追技術革新的腳步。然而,當演算法開始決定誰被看見、誰又被排除,甚至左右一個人的生命與自由時,社會便不能再只關心它能帶來多少便利。

他強調,身處科技時代,法治的角色從來不是阻擋創新,而是確保每一項影響人身權利的決策,都應該被充分理解與檢驗。唯有讓決策可以被理解、挑戰與問責,才真正談得上人權保障。

採訪撰稿/馬藤萍

攝影/翁佳如

編輯/馬藤萍

研究來源

林勤富(2022)探索人工智慧發展及應用的跨國風險管制框架。國科會專題研究計畫(國際年輕傑出學者研究計畫)

本著作由人文·島嶼著作,以創用CC 姓名標示–非商業性–禁止改作 4.0 國際 授權條款釋出。

本著作由人文·島嶼著作,以創用CC 姓名標示–非商業性–禁止改作 4.0 國際 授權條款釋出。